文章摘要:

本文将从四个方面详细阐述如何使用Python爬虫采集数据并高效地将数据存储到MySQL数据库的实践方法。首先,我们将介绍Python爬虫的基本概念和常用库,帮助读者理解如何通过爬虫从网站获取数据。其次,我们将深入探讨如何设计数据存储架构,确保数据能够高效、正确地存入MySQL数据库。接下来,我们会详细讲解如何优化爬虫的性能,减少数据抓取过程中的重复请求和数据丢失。最后,文章还会分享一些在实际开发中常见的错误和调试技巧,帮助开发者在实现爬虫的过程中避免一些常见的陷阱。通过这些内容,读者可以掌握从数据抓取到存储整个流程的核心技术,并能高效地实现自己的爬虫项目。

1、理解Python爬虫的基本概念与框架

Python爬虫是指利用Python编写程序,自动化地抓取互联网上的公开数据。Python语言的简洁性和丰富的库支持使得它成为爬虫开发中最受欢迎的语言之一。在开始编写爬虫前,首先需要理解爬虫的基本工作原理,包括向网页发送请求、解析网页内容、提取有用数据等。

常见的Python爬虫框架有BeautifulSoup、Scrapy和Requests等。其中,BeautifulSoup擅长解析HTML和XML格式的数据,非常适合用于小规模的网页抓取;Scrapy则是一个功能强大的框架,适用于大规模数据抓取,并且支持分布式爬取;Requests则是一个非常简洁的HTTP请求库,用于模拟浏览器向服务器发送请求。

除了选择合适的库外,理解爬虫的基本架构也是至关重要的。在数据抓取的过程中,爬虫需要进行URL管理、请求调度、页面下载、数据提取和存储等多个步骤。通过设计合理的工作流程,爬虫才能高效稳定地运行。

2、设计数据存储架构,确保数据完整性

设计一个高效且可靠的数据存储架构对于确保爬虫抓取的数据能够被正确地存入MySQL数据库至关重要。在数据存储时,最重要的目标是保证数据的完整性和准确性,避免出现丢失或重复的数据。

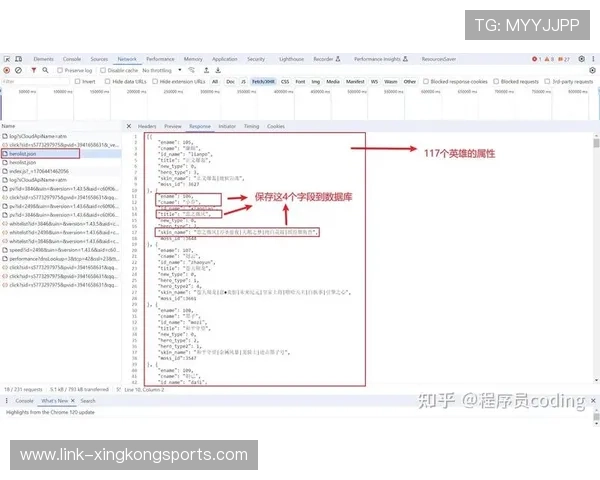

在设计数据库表结构时,首先需要考虑抓取的数据类型和字段。例如,若爬取的是新闻网站的数据,那么新闻标题、发布时间、正文内容、作者等字段应该是表的主要组成部分。接下来,设计数据库表时应避免出现重复数据,可以通过设置主键或唯一约束来避免重复插入。

为了提高数据存储的效率,建议使用批量插入的方式,而不是每抓取一条数据就执行一次插入操作。批量插入可以减少数据库的I/O操作,显著提高数据存储的速度。此外,可以采用事务管理来确保数据一致性,在插入数据时保证原子性和一致性,避免出现部分数据插入成功而其他数据失败的情况。

爬虫的效率和稳定性直接影响到数据抓取Starsky Sports的速度和质量。在优化爬虫性能时,首先需要考虑如何避免重复抓取同一页面。为了防止重复请求,可以采用URL去重的方式。常见的方法包括利用哈希算法生成URL的唯一标识,或使用集合(set)来保存已经抓取的URL,从而避免重复抓取。

此外,爬虫的并发抓取能力也是提升性能的关键。在抓取大量数据时,串行请求会导致爬取速度极慢,因此我们可以通过使用多线程或异步IO来实现并发请求。Python的`threading`和`asyncio`库可以帮助实现这一目标,而Scrapy框架本身也提供了异步请求的支持,极大地提高了爬虫的执行效率。

另一个性能优化方面是控制请求的频率,避免对服务器造成过大压力。可以通过设置请求间隔时间,使用代理IP池,或通过模拟浏览器行为来避免被目标网站封禁。对于数据量巨大的爬虫项目,分布式爬取也是一种提升性能的有效手段。

4、常见错误和调试技巧,避免开发中的坑

在实际开发Python爬虫时,常常会遇到一些问题和错误。了解这些常见错误并掌握调试技巧能够帮助开发者在开发过程中减少许多困扰。例如,当爬虫出现“403 Forbidden”或“404 Not Found”错误时,可能是由于访问频率过高或请求头信息不合法造成的。此时,可以尝试使用代理IP池或者模拟浏览器请求头来绕过这些限制。

另外,数据抓取时有时会出现数据解析错误。这通常是因为网页结构发生变化,导致解析时出现问题。此时,我们可以通过使用浏览器的开发者工具检查网页元素,调整解析逻辑来解决这一问题。针对大型爬虫项目,可以通过日志记录和异常捕获来及时发现和解决问题。

在存储数据到MySQL数据库时,也可能会遇到插入失败、连接超时等问题。遇到这些问题时,可以通过捕获异常并重试的方式来确保数据的成功插入。同时,设置合理的数据库连接池和优化SQL查询也是提高存储效率和避免数据库瓶颈的重要手段。

总结:

本文从四个方面详细介绍了如何使用Python爬虫抓取数据并将数据高效存储到MySQL数据库的实践方法。首先,了解爬虫的基本概念和常用框架是开发爬虫的基础;其次,设计合理的数据存储架构可以确保数据的完整性和效率;然后,通过优化爬虫性能,避免重复抓取和数据丢失,提升抓取效率;最后,掌握常见的错误和调试技巧,有助于解决开发过程中遇到的问题。

总的来说,Python爬虫的开发需要结合实际情况选择合适的框架和技术,合理设计存储架构,并且通过性能优化和错误调试来确保爬虫的稳定性和效率。通过掌握这些核心技能,开发者可以高效地从互联网上获取数据,并将其存储到MySQL数据库中,为后续的数据分析和应用打下坚实的基础。